When talking about data and its analysis, machine learning comes to mind very quickly, and indeed machine learning has provided excellent solutions in many of our projects. However, we have sometimes hit some limitations as well, for instance when certain data are rare or difficult to obtain, or when computing power is scarce, such as in embedded applications. A possible solution is to combine different classification models – let’s call this hybrid classification – which I would like to present below based on an abstracted example.

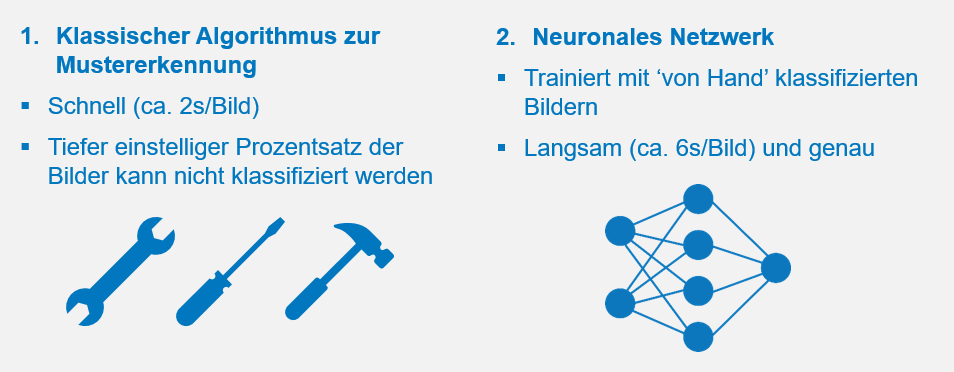

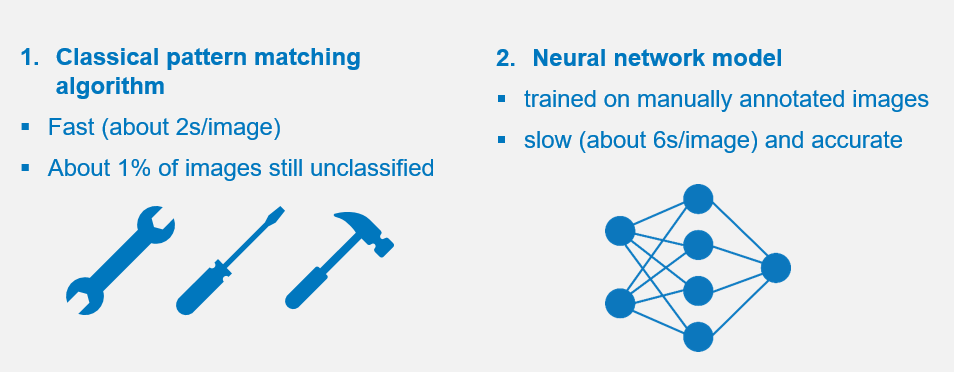

In the following example, the system should recognized whether a robot arm has gripped a tool or not based on some pictures from a camera. This classification is the basis of further automation of the system. To classify these images successfully and reliably in all possible cases, a machine learning model that can distinguish between the cases of ‘a tool is present’ and ‘no tool present’ needs a large amount of training data, i.e. labelled images.

Für eine mögliche Automatisierung des Systems soll anhand der Bilder einer Kamera erkannt werden, ob ein Roboterarm ein Werkzeug im Greifer hat oder nicht. Um die Erkennung in allen möglichen Fällen verlässlich und korrekt hinzubekommen benötigt ein Machine-Learning-Modell, das die Klassifizierung zwischen ‘kein Werkzeug im Greifarm’ und ‘Werkzeug vorhanden’ durchführen kann, sehr viele Bilder (Trainingsdaten).

Dieses Beispiel zeigt, wie klassische Datenverarbeitungsmethoden gemeinsam mit maschinellem Lernen eingesetzt werden können. Komplexe neuronale Netzwerke können sehr vieles lernen, brauchen aber andererseits sehr viele, mit der Klassifizierung annotierte Daten. Mit Template Matching gelingt es, Informationen, die über das Problem bekannt sind, ins Modell einzubauen, und zwar bei geringerem Leistungsaufwand – was je nach Anwendung entscheidend sein kann. Ganz nach dem Motto: «Das Beste aus zwei Welten!»

In the following example, the system should recognized whether a robot arm has gripped a tool or not based on some pictures from a camera. This classification is the basis of further automation of the system. To classify these images successfully and reliably in all possible cases, a machine learning model that can distinguish between the cases of ‘a tool is present’ and ‘no tool present’ needs a large amount of training data, i.e. labelled images.

This example demonstrates how classical data processing methods can be combined with machine learning, exploiting the advantages of both approaches: Complex neuronal networks can learn a great many things but need large amounts of annotated data. Template matching manages to incorporate known information about the classification into the model, using fewer computing resources. This way, we get the best of both worlds!

Author: Sara Hänzi